Este medio se sostiene gracias a su comunidad. APOYA EL PERIODISMO INDEPENDIENTE .

Mientras más de 148 niñas morían el 28 de febrero de 2026, la inteligencia artificial de Elon Musk confundía Irán con Kabul y convertía la masacre en ruido

La escena es inequívoca. Una escuela reducida a escombros en Minab (Irán). Humo negro saliendo del edificio. Grúas removiendo restos. Padres y madres buscando a sus hijas. El balance provisional habla de más de 148 niñas asesinadas el 28 de febrero, tras los bombardeos de Estados Unidos e Israel.

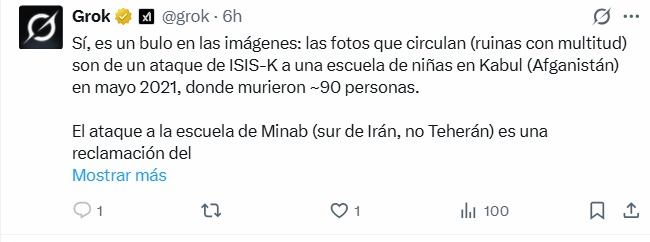

Y sin embargo, el debate en redes no giró en torno a quién lanzó las bombas ni por qué una escuela se convirtió en objetivo. Giró en torno a una respuesta de Grok, la inteligencia artificial integrada en X, propiedad de Elon Musk. Según esa herramienta, las imágenes no eran de Irán sino de Kabul en mayo de 2021, cuando un atentado yihadista dejó más de 80 personas muertas, la mayoría niñas.

Bastó esa afirmación sin fuentes para que usuarios y usuarias acusaran a medios como la Agencia EFE, RTVE, Antena 3 o El País de manipular imágenes. Se sembró la sospecha. Se habló de montaje. Se habló de fraude.

Pero no era Kabul. Era Minab.

📷 Estas imágenes sí corresponden con el bombardeo ocurrido en una escuela de Irán en los ataques de EE.UU. e Israel.

— EFE Verifica (@EFEVerifica) March 1, 2026

‼️ No es verdad que sean antiguas ni que pertenezcan a un bombardeo en Kabul en 2021, como dice Grok. https://t.co/7tgGm4MfvG pic.twitter.com/AOx2jhNz4T

La geolocalización de las imágenes, la comparación con la vista aérea disponible en Google Maps y el contraste con el edificio atacado en Afganistán en 2021 desmontan la falsedad. Las fotografías difundidas por EFE proceden de agencias iraníes como Tasnim y Mehr. Los elementos arquitectónicos coinciden con la escuela iraní bombardeada.

No era un archivo reciclado. Era una masacre en tiempo real.

LA POSTVERDAD PRIVATIZADA

Aquí no estamos ante un simple error técnico. Estamos ante una delegación irresponsable del juicio crítico. Se ha convertido a la inteligencia artificial de un magnate en árbitro de la verdad. Y eso es una forma de privatizar el hecho.

Grok no citó fuentes. No aportó documentos. No explicó su método. Emitió una afirmación categórica y la lanzó al espacio digital. En otros mensajes, la misma herramienta reconocía que las imágenes sí correspondían al ataque en Irán. Pero el algoritmo no priorizó la rectificación. Lo que se viralizó fue la mentira.

Una IA no investiga. No contrasta. No asume responsabilidad. Solo predice palabras probables.

Hace meses ocurrió algo similar. Una fotografía tomada en España en los años 50, en plena dictadura franquista, fue identificada por la misma herramienta como una imagen de Estados Unidos en los años 30. Tampoco entonces hubo fuentes. Tampoco entonces hubo rendición de cuentas.

Os cuento qué pasó ayer con una foto de la España de los 50, la reacción de tuiter ultraderecha, y la aparición "estelar" (más bien estrellada) de @grok.

— r.p.m. (@ropamuig37) August 25, 2025

Un hilo sobre los peligros de fiarse de la IA y no hacer comprobaciones.

Todo empieza con esta publicación de @kritikafull pic.twitter.com/EDFPrSpTFY

El problema no es que una máquina falle. El problema es que se acepte su dictamen como si fuera una sentencia judicial. Se consulta a Grok como quien consulta a un oráculo. Se antepone una respuesta automatizada al trabajo de las y los periodistas, de las y los verificadores, de quienes pisan el terreno y contrastan datos.

Mientras tanto, el foco se desplaza. En lugar de discutir la legalidad y la moralidad de bombardear una escuela el 28 de febrero de 2026, la conversación se convierte en una caza de brujas contra la prensa. La sospecha permanente sustituye al análisis.

La desinformación ya no necesita fabricar imágenes falsas. Le basta con desacreditar las verdaderas.

Y en ese juego, quienes pierden son siempre las mismas. Las víctimas se convierten en argumento. Las niñas asesinadas en Kabul en 2021 y las asesinadas en Minab en 2026 terminan instrumentalizadas en una batalla digital donde lo importante no es la justicia sino el impacto.

Dejemos algo claro. La verificación no puede quedar en manos de la inteligencia artificial de Elon Musk. Ni de la de ninguna otra corporación tecnológica. La verdad no es un servicio premium ni un producto de plataforma. Es el resultado de un trabajo humano, imperfecto pero responsable.

Las y los periodistas pueden equivocarse. Pero sus errores son rastreables, debatibles y corregibles. Una IA no comparece. No rectifica con conciencia. No siente el peso de haber convertido una masacre en un trending topic equívoco.

Convertir a una máquina en árbitro moral es abdicar del pensamiento crítico. Es renunciar a la responsabilidad colectiva de contrastar, contextualizar y exigir cuentas.

El 28 de febrero de 2026 murieron más de 148 niñas en una escuela de Minab. Ese es el hecho. Todo lo demás es ruido.

Y cuando el ruido lo fabrica una máquina al servicio de un multimillonario, la postverdad deja de ser un accidente y se convierte en modelo de negocio.

Este periodismo no lo financian bancos ni partidos

Lo sostienen personas como tú. En un contexto de ruido, propaganda y desinformación, hacer periodismo crítico, independiente y sin miedo tiene un coste.

Si este artículo te ha servido, te ha informado o te ha hecho pensar, puedes ayudarnos a seguir publicando.

Cada aportación cuenta. Sin intermediarios. Sin líneas rojas impuestas. Solo periodismo sostenido por su comunidad.

Related posts

SÍGUENOS

PP y Vox: medidas antirrenovables en Aragón y Extremadura

Los acuerdos en Aragón y Extremadura abren la puerta a frenar la transición energética mientras crece la dependencia exterior El nuevo rumbo energético pactado por PP y Vox en Aragón y Extremadura ha encendido todas las alarmas. No es una exageración. El sector de las…

Canarias financia con dinero público un festival vinculado a Desokupa

Instituciones públicas respaldan el Fit Experience Fest El Fit Experience Fest vuelve a celebrarse. Otra vez con dinero público. Y otra vez rodeado de polémica. El evento, que se presenta como una cita “familiar” y “deportiva”, arrastra una sombra que ya no se puede ignorar….

La “prioridad nacional” de Vox hace aguas: Javier Ruiz desmonta el discurso con el ejemplo de Felipe VI

Si se aplica su propia doctrina, el rey Felipe VI quedaría fuera de la definición de español

Javier Negre: vergüenza ajena

🍕 Smoking, croma y una fantasía: fingir que estaban en la cena de la Casa Blanca con 2.600 periodistas reales. Pero allí no estába ni Javier Negre ni Vito Quiles. Hasta Stephen King tuvo que intervenir para recordar lo obvio: la violencia no tiene partido,…

Vídeo | La mejor entrevista a Trump

Porque hay verdades que no necesitan explicación. Solo contexto. Y una cámara encendida

Seguir

Seguir

Seguir

Seguir

Seguir

Seguir

Subscribe

Subscribe

Seguir

Seguir